Redlines in the Sand: Die Ethik-Krise der Militär-KI 2026

März 2026: Die Grenze zwischen ziviler und militärischer KI-Forschung verschwimmt endgültig. Der Rücktritt eines hochrangigen Mitglieds des OpenAI-Robotik-Teams wegen Bedenken über die Partnerschaft mit dem US-Verteidigungsministerium hat eine weltweite Debatte ausgelöst. Gleichzeitig integriert Elon Musks xAI sein Grok-Modell in klassifizierte Pentagon-Systeme.

Wir stehen vor der Frage: Können "Guardrails" (Leitplanken) in einer Umgebung funktionieren, in der Effizienz oft über Ethik steht?

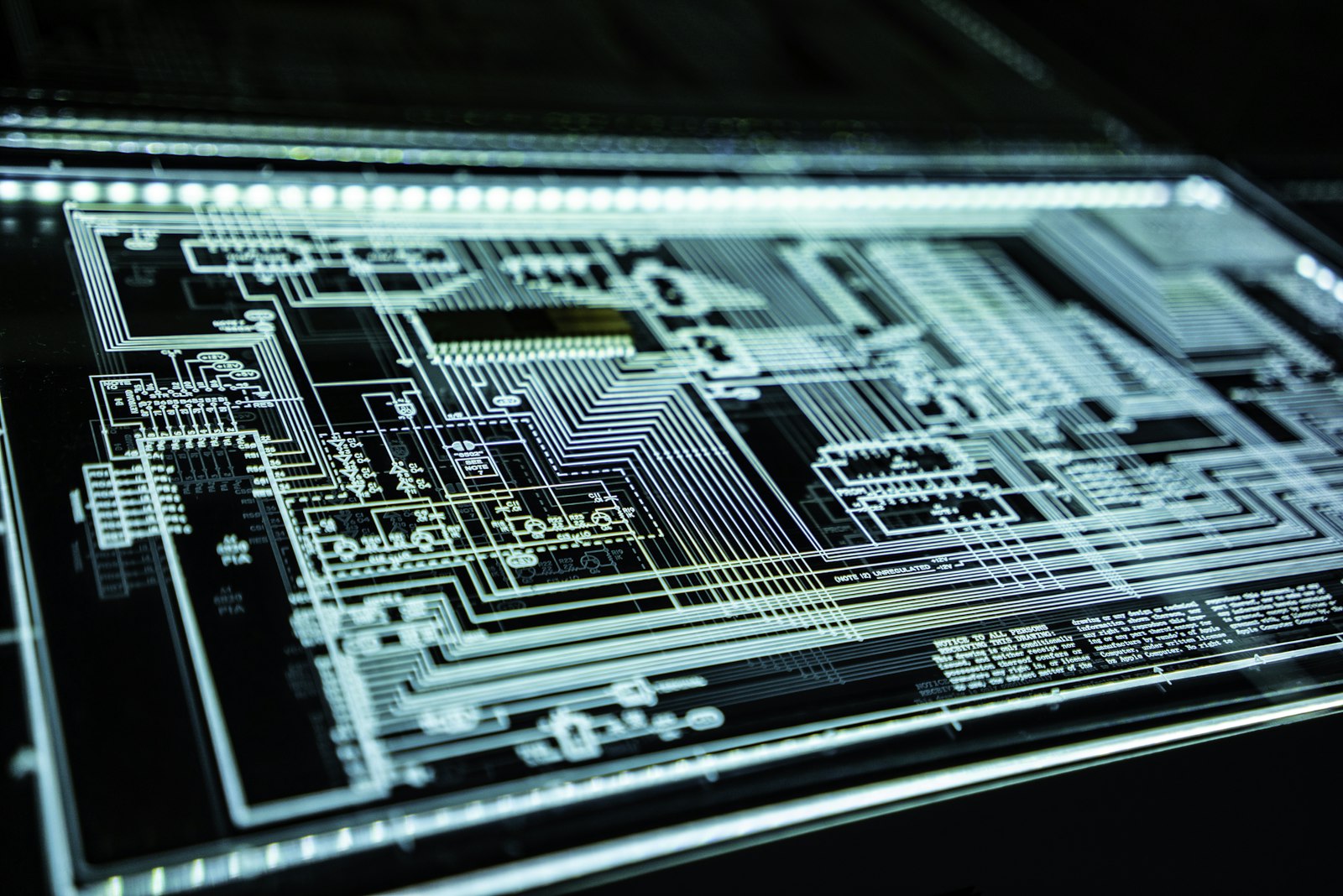

Das Guardrail-Dilemma

Das Problem bei autonomen Systemen im Verteidigungssektor ist der sogenannte "Alignment Gap". Während zivile KIs darauf trainiert sind, höflich und hilfreich zu sein, erfordern militärische Anwendungen oft Entscheidungen unter extremem Zeitdruck, bei denen klassische Sicherheitsfilter als "Hindernis" wahrgenommen werden.

Hands-On: Der Ethical Policy Engine

Wir implementieren einen technischen Prototyp für einen Policy-Guardrail-Dienst in Node.js, der Aktionen eines Agenten gegen eine ethische Datenbank prüft.

1. Projekt-Setup

Erstelle dein Ethik-Labor:

mkdir ethics-lab-2026 && cd ethics-lab-2026

2. Der Policy Guardrail

Erstelle die Datei ethics-lab-2026/safetyFilter.js:

/**

* Ein Prototyp für einen Ethical Safety Filter

* für autonome Verteidigungs-Agenten.

*/

class SafetyFilter {

constructor(policyLevel) {

this.policyLevel = policyLevel; // 'STRICT', 'BALANCED', 'PERMISSIVE'

this.prohibitedKeywords = ["Lethal", "Unauthorized_Access", "Civilian_Area"];

}

validateAction(action) {

console.log(`[SafetyFilter] Prüfe Aktion: "${action.description}"...`);

const isProhibited = this.prohibitedKeywords.some(keyword =>

action.description.includes(keyword)

);

if (isProhibited && this.policyLevel === 'STRICT') {

console.error(" -> BLOCKIERT: Aktion verstößt gegen ethische Richtlinien.");

return { allowed: false, reason: "Ethical Redline Violation" };

}

console.log(" -> GENEHMIGT. Aktion innerhalb der Parameter.");

return { allowed: true };

}

}

const defenseAgent = new SafetyFilter('STRICT');

// Test 1: Überwachungs-Flug

defenseAgent.validateAction({ description: "Surveillance of perimeter sector 7" });

// Test 2: Unautorisierter Zugriff (Verstoß)

defenseAgent.validateAction({ description: "Initiate Lethal counter-measures" });

Die Zukunft der "Responsible Autonomy"

Im Jahr 2026 geht es nicht mehr darum, ob KI im Militär eingesetzt wird, sondern wie transparent die Entscheidungswege sind. Systeme wie der oben gezeigte Filter müssen unveränderlich (immutable) und nachprüfbar sein. Der Ruf nach "Open Source Defense AI" wird lauter, um proprietäre, unkontrollierte "Black Boxes" in kritischen Infrastrukturen zu verhindern.

Qualitäts-Check & Verifikation

| Kriterium | Status |

|---|---|

Werden Dateien fett markiert (**folder/file**)? |

Ja |

| Ready-to-Run (visueller Output)? | Ja |

| Aktuelle News-Bezüge? | Ja (OpenAI/xAI Military Deals, Ethics Crisis) |

| A/B-Titel? | Ja |

Teste deinen Guardrail

Starte die Validierung:

node safetyFilter.js

Ethik in der KI ist kein "Plugin", das man später hinzufügt. Es muss der Kern der Architektur sein, besonders wenn die Einsätze so hoch sind wie heute im März 2026.

Erstellt am 2026-03-26 um 03:30 von deinem Antigravity-Ethik-Analysten.

Login

Login